凤凰网科技 出品

作者|董雨晴

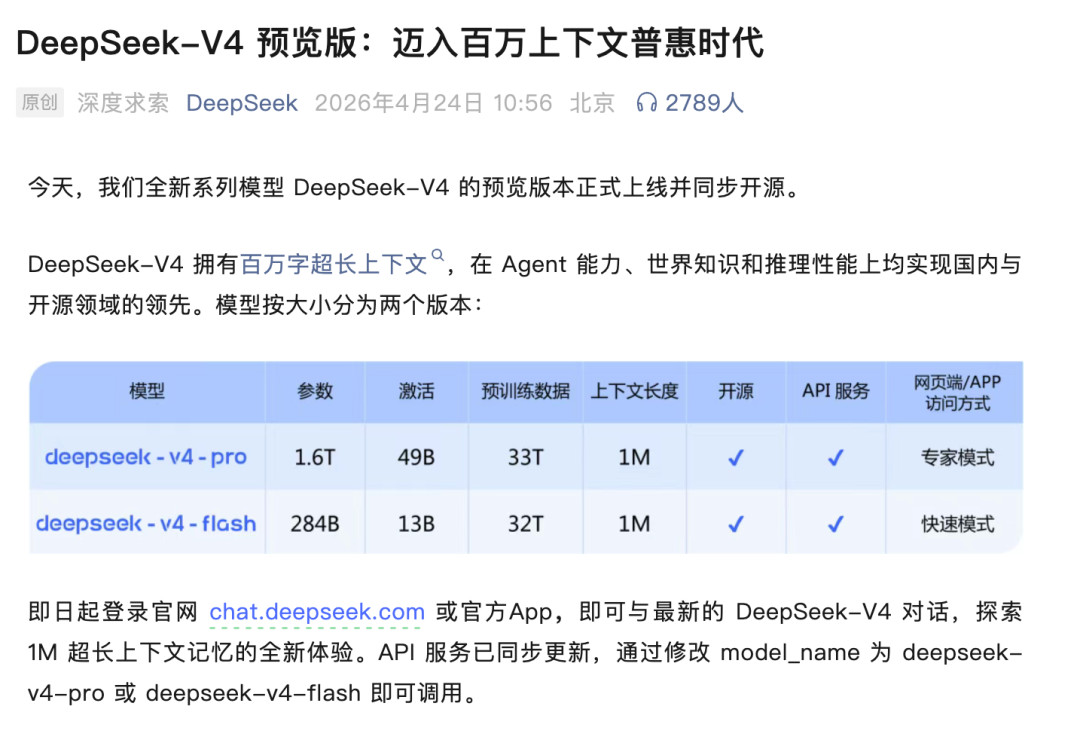

千呼万唤,4月24日上午,DeepSeek终于扔出重磅炸弹,全新系列模型DeepSeek-V4预览版正式上线并同步开源,在Agent能力、世界知识和推理性能三大维度宣布达到国内及开源领域领先水平。从2月8日上线测试版至今,其始终保持着神秘的姿态。

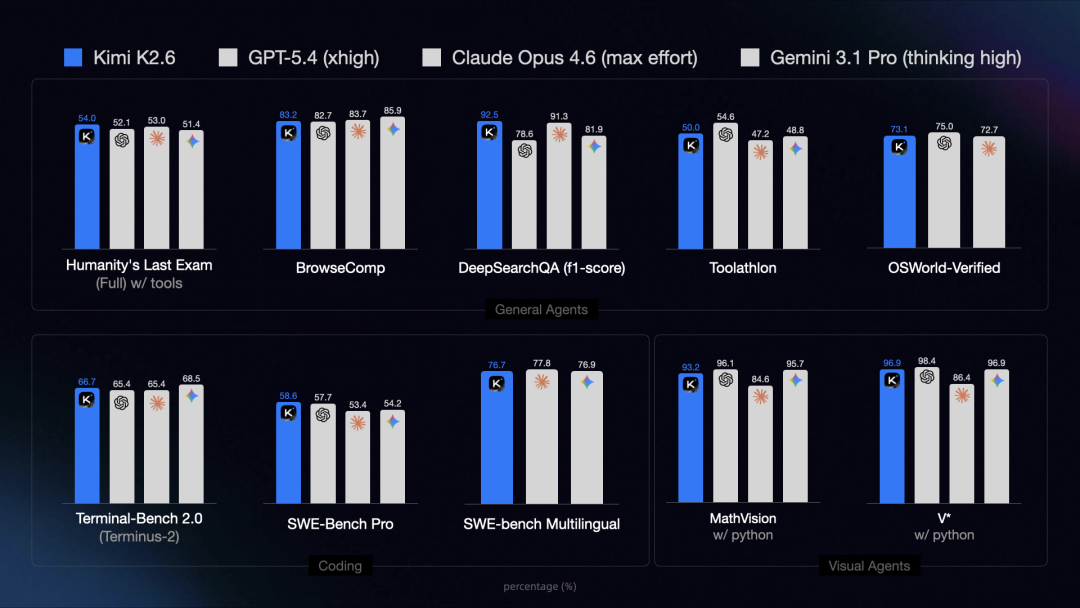

就在四天前的周一晚上,月之暗面同样发布并开源了Kimi K2.6模型,主打长程编码和Agent集群能力,在多项基准测试中持平甚至优于GPT-5.4、Claude Opus 4.6等闭源模型。

凤凰网科技统计发现,这已经是Kimi和DeepSeek的第五次“撞车”。

不仅如此,这一次双方在架构层面有了更多吸纳与借鉴。

就连在资本市场,二者也被拿来并列。据The information报道,DeepSeek正在寻求首轮外部融资,在估值方面就参考了Kimi。

一次两次的撞车或许是巧合,但这两支中国队伍显然已在过去两年的摸高探索中形成了一种默契。开源策略叠加创新互惠,让双方都比既定路线走的更快。

中国最强的两个开源模型,正以一种心照不宣的方式,从两个不同的方向合力包抄海外巨头的腹地。

五次撞车,蛛丝马迹越来越多

先说前几天的Kimi K2.6。月之暗面已经有段时间不在单个模型上堆参数了。但从2.5到2.6,模型却越来越会干活了。

据称2.6在单个工程任务中持续12小时、发起4000多次工具调用,在官方测试中完成从零构建SysY编译器到通过140项功能测试的复杂任务——官方估算,这相当于4名工程师两个月的工作量。

用杨植麟之前概括的三个词来说,就是Token效率、长上下文、Agent集群。

DeepSeek V4也有三个关注点,即百万上下文,万亿参数和下半年适配国产算力。在架构层面,V4采用大规模混合专家(MoE)架构,完整版总参数高达1.6万亿。创新注意力机制在Token维度进行压缩,结合DSA稀疏注意力,相比传统方法大幅降低计算与显存需求,1M上下文正式成为DeepSeek所有官方服务的标配。

新模型的看点不展开说了,这次想回顾下几个巧妙的撞车点。

Kimi和DeepSeek的“撞车史”,最早可以追溯到Kimi 1.5与DeepSeek R1的发布时间重叠,当时大家还替Kimi惋惜,认为强者遇强者,是一种压力。此后,两边的发布节奏重叠次数越来越多,凤凰网科技此前也报道过《Kimi和DeepSeek又又又撞车》。

就拿上下文来说,Kimi其实是国内最早做百万上下文的,2024年时就提过对应200万文字,当时长文本一度是Kimi非常亮眼的标签。不过比较遗憾的是,当时Kimi没解决成本问题,这次DeepSeek再提长文本,就已经把成本打下来了。

这次V4 API标准费率为输入每百万Token 0.30美元,缓存命中时低至0.03美元,仅为GPT-4o价格的约1/20至1/50。按照人民币计价,V4-Flash输入价格仅为1元/百万Token(缓存未命中)、输出2元/百万Token;V4-Pro输入为12元/百万Token、输出24元/百万Token。

另外,Kimi下一代模型的亮点其实也是长上下文,但在路线上两者有点不一样,DeepSeek探索的是稀疏注意力,Kimi探索的事线性注意力。

至此,DeepSeek和Kimi拿出了中国唯二万亿已开源模型。

开源的合力,对垒硅谷三巨头

在全球的AI竞赛里,有人负责做0-1的创新,有人负责1-100的工程复制,但难的是前者需要全球范围内那1%的天才,后者更适合军团作战的大厂。过去,外界常常说0-1的创新容易发生在美国,后者容易发生在中国。

但从DeepSeek和Kimi开始,0-1的创新开始更多的发生在中国。这给了海外AI厂商巨大压力。

凤凰网科技了解到,梁文锋在创立DeepSeek之后,对应用和市场都不是最感兴趣的,他更在乎底层创新,2025年初的R1以多头潜在注意力的架构创新击穿了深度思考的成本。另有行业人士告诉凤凰网科技,尽管融资曾打乱Kimi的节奏,但在2025年DeepSeek走红后,Kimi也回归技术,继续钻研底层创新。

而Kimi从K2到K2.5,其底层架构与DeepSeek V3一脉相承,本质上是在后者基础上的规模化扩展。到了2026年, DeepSeek团队在1月连续发布的两篇论文mHC与Engram中,开始大量参考Kimi此前开源的优化器、注意力架构等研究成果。

这种中国开源模型在底层技术的你追我赶,让中国的底层创新形成了良性循环,最终带动了国内开源阵营的集体逆袭。

MIT与Hugging Face联合发布的报告显示,过去一年中国开源模型的全球下载量占比达到17.1%,首次反超美国的15.86%。全球头部AI模型API聚合平台OpenRouter的数据则显示,2026年2月,中国AI模型的调用量三周大涨127%,全球前五中占据四席——包括MiniMax、Kimi、智谱和DeepSeek。一年前,这个数字还不到2%。

DeepSeek撬开硅谷视野时,Kimi的市场空间也被打开了;当Kimi在长文本和Agent领域持续突破时,DeepSeek在推理效率上的极致追求又给整个行业带来了新的参照系。

一位业内人士对凤凰网科技表示,Kimi与DeepSeek的撞车早就已经不是内卷,而是一种“惺惺相惜”——“两个最强的中国开源模型交替冲锋,合力围剿的是海外闭源巨头。”

4月24日凌晨,OpenAI面向付费用户上线GPT-5.5并官宣API计划,标准版API定价为每百万Token输入5美元、输出30美元,较前代GPT-5.4翻倍,Pro版更达到输入30美元、输出180美元。

2026年初,斯坦福HAI发布的《AI指数报告》显示,截至年初,美国顶级AI公司Anthropic最先进模型的性能仅领先中国最强竞争对手2.7个百分点。美国私人AI投资高达2859亿美元,是中国的23倍。但“用23倍的资本砸出2.7%的差距”,这可能已经不是美国AI的优势,而是中国AI的护城河。

无论是K2.6还是DeepSeek V4,可能都是分水岭级别的产品。

两者选择了不同的技术路径,Kimi深耕长程执行和Agent集群,DeepSeek聚焦推理效率和极致性价比——但在底层逻辑上又高度一致:用开源打破闭源垄断,用效率对冲算力限制。

AGI双雄格局初现

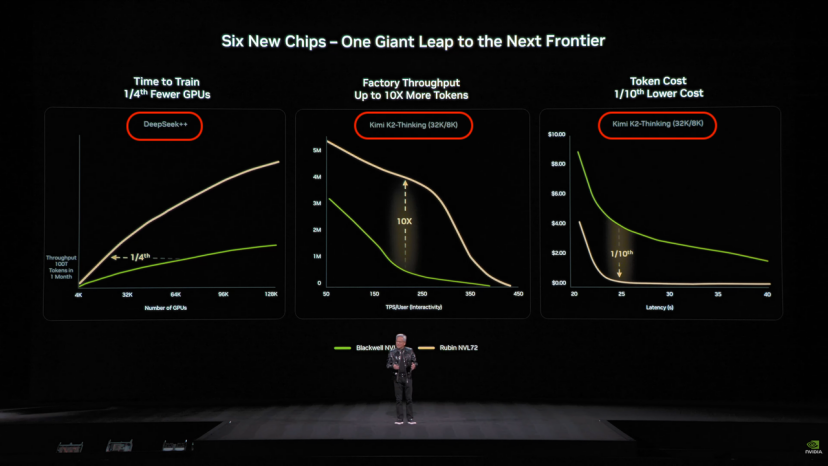

去年英伟达带火了中国AI的御三家,其中就有Kimi和DeepSeek,在英伟达GTC大会上,Kimi和DeepSeek也是被用来Benchmark 芯片性能的两家中国开源模型。

近期,凤凰网科技访谈了多位年轻前沿科学家,也多认为DeepSeek和Kimi有着相似的组织形态与创新环境,都是员工数不多,但人才密度极高。都是从底层技术出发探索AGI,也有着相似的技术前瞻性。

他们也都愿意吸纳年轻人,DeepSeek的核心研究员有非常多年轻人,Kimi也广纳贤才,下放到本科生,甚至是高中生。

Kimi与DeepSeek开始有越来越多相似的轨迹,另一个值得关注的维度是芯片。杨植麟在2026年3月的英伟达GTC演讲台上坦言,“目前普遍使用的很多技术标准,本质上是八九年前的产物,逐渐成为Scaling的瓶颈。”Kimi为此给开源社区贡献了二阶优化器MuonClip和Kimi Linear架构。DeepSeek V4则直接选择了用华为芯片做推理,共同为国产算力生态发展做努力。

据杨植麟判断,大模型的本质是“将能源转化为智能”,而规模化不是暴力堆砌算力与能源,而是以提升效率为核心。

这可能也会是中国开源模型的集体叙事转变,不再执着于与GPT-5.4、Claude Opus 4.7等对手在benchmark上死磕,而是定义一种全新的价值体系——低成本、高可及性、自主可控。

第五次撞车或许不会是中国开源模型最后一次在时间线上的“巧合”。

从K1.5借鉴DeepSeek R1的强化学习路线,到DeepSeek V4沿用Kimi的长上下文研究成果,中国的开源力量正在用自己的方式证明:最高效的竞争,是让对手成为自己生态的一部分。

AI竞赛的下半场,规则正在由中国开源模型重新书写。而Kimi和DeepSeek们,无疑是这段历史最核心的注脚。

本文转自:凤凰网科技

原文地址: https://tech.ifeng.com/c/8sYPQuP3nLH

小同爱分享2 个月前

疫情,就是让人抑郁,又没了感情。 - 小同爱分享

小同爱分享2 个月前

所谓生活不如意,就是缺少人民币。 - 小同爱分享